par caroline@inwest.fr | Jan 22, 2026 | Innovation

Dans notre contribution précédente, nous avons fait connaissance avec les Big Data. Je vous propose maintenant un éclairage en profondeur pour comprendre quels sont les enjeux de l’essor des Big Data. On va parler dollars, politique et nouveaux modes de propagande.

L’élan entrepreneurial autour du Big Data

Qui dit défi technique dit énergie créatrice pour le résoudre. Pour préparer cet article, Silicon-Valley.fr a rencontré Sean Gourley, Docteur en physique, TED Talk Fellow, Rhodes Scholar, qui a co-fondé l’entreprise Quid un exemple de succès lié aux Big Data. Quid récolte les données qui sont disponibles publiquement sur les compagnies privées innovantes et sur les investisseurs qui les financent, traquant le nombre de leurs employés, leur capacité à lever des fonds, les procès qui leur sont intentés, les nouveaux partenariats, bref, tous les événements majeurs de la vie d’une entreprise. Ces informations sont modélisées grâce au logiciel de Quid sous forme d’une « carte de l’innovation », qui permet aux clients de Quid, comme Microsoft Corp. par exemple, de traquer les entreprises et les technologies innovantes dans le secteur qui les intéresse.

Cette modélisation haute précision permet de visualiser les secteurs où un rapprochement technologique serait profitable (le monde de la cryptographie et celui des technologies mobiles par exemple), et les nouveaux marchés à conquérir. Plutôt qu’un rapport volumineux produit pas des consultants à un moment donné, et obsolète dès qu’il est imprimé, les données de Quid sont accessibles et actualisées en temps réel.

Quid est financé notamment par le Founders Fund de Peter Thiel (fondateur de Paypal), un fond d’investissement de capital risque basé à San Francisco.

Les business model des Big Data

Les startups qui se développent autour de l’idée du Big Data promettent à leurs investisseurs des retours avantageux. Comment passe-t-on du traitement de grosses bases de données à la récolte pécuniaire ? Trois business modèles principaux se sont imposés.

Le modèle des revenus publicitaires : Google, Facebook, Yelp

L’exemple canonique est celui de Google, qui s’est imposé comme le moteur de recherche le plus efficace du web, c’est-à-dire celui ayant réussi à répertorier au mieux et à rendre accessible le plus facilement l’énorme base de données qu’est Internet. Il s’ensuit des revenus faramineux grâce aux contenus publicitaires des annonceurs qui veulent être vus sur les pages du géant du web.

Le modèle de la vente des données : LinkedIn

LinkedIn, c’est la rencontre des Big Data et des ressources humaines. L’entreprise, qui a son siège juste à côté de Google, a réussi à s’imposer comme le réseau social du monde professionnel, avec deux nouveaux utilisateurs qui viennent rejoindre chaque seconde les 240 millions déjà présents. La valeur de l’action a d’ailleurs été multipliée par six depuis la capitalisation boursière de 2011. La principale source de revenu de LinkedIn, c’est un ensemble d’outils de recrutement vendus aux entreprises, et dont la valeur dépend principalement de l’étendue de sa base de données, c’est-à-dire la précision des informations que nous avons bien voulu y déposer.

La redirection de trafic : Amazon, Google Books

Les recommandations proposées par ces plateformes qui mettent à disposition des contenus permettent de rediriger le trafic des consommateurs vers d’autres produits à consommer, ce qui augmente les ventes. Exemple de succès massif : Amazon. La richesse d’Amazon, c’est d’avoir pu se constituer une base de données tellement vaste sur les comportements d’achat de tout un chacun que chaque vente participe à la précision des recommandations et peut ainsi générer d’autres ventes, à l’infini.

Pour ces trois modèles, les critères de réussite sont identiques et reposent sur :

- le volume des données recueillies (plus il est important, plus la modélisation sera juste)

- des infrastructures efficaces pour le traitement des données dont le volume est toujours croissant

- des interfaces qui rendent l’expérience des consommateurs souple et leur donnent envie de partager leurs données.

Ariane Zambiras

par caroline@inwest.fr | Jan 22, 2026 | Innovation

Alors que les Anglais viennent à peine de découvrir la 4G, mais l’industrie de la téléphonie mobile est déjà en train de préparer la 5G. Pourquoi tant d’empressement ?

Il est bien loin le temps où Motorola nous montrait, en 1973, un prototype de la première génération de téléphones sans fil. La première génération de téléphones grand public des années 1980 utilisait une technologie analogique qui nous permettait seulement de transmettre la voix.

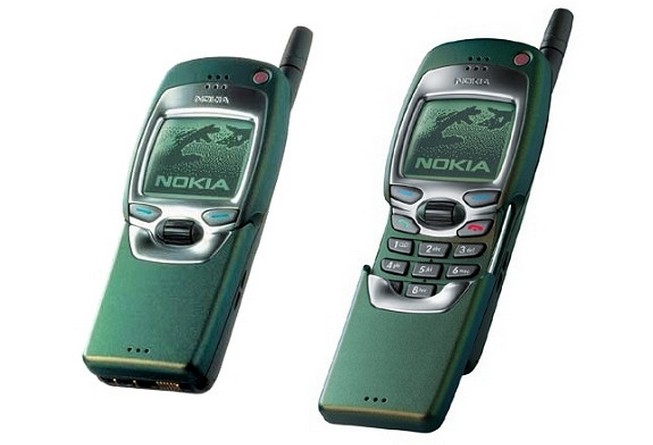

La seconde génération, celles des années 1990, a adopté le standard GSM (Global System for Mobile communications), un standard international qui permet la transmission de paquets de données et ouvre ainsi la voie vers la transmission de texte. Poursuivant dans cette lancée, le Nokia 7110 fut le premier téléphone nous permettant d’avoir accès au web, c’était en 1999 !

En 2007, Apple introduit l’iPhone, et les choses changent du tout au tout. Pensé d’abord comme un ordinateur, puis comme un téléphone, l’iPhone a eu comme conséquence de décupler le volume de données en circulation sur les réseaux, un volume qui double d’année en année. C’est pour faire face à ces augmentations, la 4G est lancée en 2012.

La question qui se profile alors naturellement, et qui devra être résolue par la 5G, c’est comment optimiser au mieux les ressources limitées de fréquence radio, et la demande exponentielle de volume de données demandée par nos modes de vie de plus en plus connectés.

par caroline@inwest.fr | Jan 22, 2026 | Innovation

Au moment où j’écris ces lignes, il y a précisément 12.031.925 Bitcoins (BTC) en circulation. La dernière transaction s’est faite pour 829.98 dollars (sur l’échange MtGox). La capitalisation totale des bitcoins est donc de l’ordre de 10 milliards de dollars. Je peux même assister en temps réel à la naissance de chaque Bitcoin sur la page Fiatleak. On sait tout sur chaque Bitcoin créé en lisant le journal qui a enregistré toutes les transactions depuis le début. Ce journal s’appelle la Block Chain et il est disponible gratuitement sur bitcoin.org (attention, la Block Chain est maintenant de l’ordre de 10 MB !). Le même site vous donnera un choix de portefeuilles (Bitcoin Wallets) et vous donnera une adresse (publique) ainsi qu’une clé (privée bien sûr). Ne la perdez pas car sans elle, vous perdez tout votre portefeuille ! Les programmes sont publics et souvent gratuits. C’est d’ailleurs cette « transparence » qui est le moteur de sécurité du monde des Bitcoins.

Mais au même moment où nous pensons tout savoir sur cette crypto-monnaie, nous nous rendons vite compte que nous ne savons que peu, à commencer par qui a créé le système et comment il fonctionne réellement. C’est ce que nous allons tenter de découvrir ensemble.

D’où viennent les Bitcoins ?

La naissance du système remonte à la publication en 1998 par Wei Dai sur la Cypherpunk Mailing list suggérant qu’une nouvelle forme de monnaie pouvait être créée en utilisant des techniques de cryptographie. Mais c’est en 2008 que la première réalisation apparait avec la publication d’un papier intitulé « Bitcoin : A Peer-to-peer Electronic Cash System » publié dans The Cryptography Mailing List par un auteur nommé Satoshi Nakamoto. Pour bien montrer qu’il était sérieux, Satoshi Nakamoto publie en 2009, en Opensource, le premier programme capable de miner des Bitcoins, créant ainsi le Réseau Bitcoin (Bitcoin Network) et le premier Block (The Genesis block) pour lequel il reçoit les premiers Bitcoins. La première transaction connue est l’achat par Laszlo Hanycek, un programmer vivant en Floride, de deux pizzas délivrées par Papa John pour 10,000 Bitcoins. Ce sont sans doute les pizzas les plus chères du monde puisque 10,000 BTC valent aujourd’hui plus de huit millions de dollars !

Le seul problème est que Satoshi Nakamoto n’existe pas. La seule chose dont on puisse être certain est qu’il s’agit d’un pseudonyme. Qui se cache derrière ce nom ? Il y a de nombreuses théories. Ted Nelson (le créateur du mot hypertext) pense qu’il s’agit du mathématician Shinichi Mochizuki (connu pour sa solution de la ABC Conjecture), d’autres pensent au trio Neal J. King, Charles Bry et Vladimir Oksman qui ont déposé des brevets sur le sujet, d’autres enfin pensent qu’il s’agirait d’une conspiration entre gouvernements asiatiques pour détrôner le dollar comme monnaie de réserve. Ce que l’on sait, c’est qu’en 2010, Satoshi Nakamoto a publié un dernier papier indiquant qu’il était temps pour lui de faire autre chose. Depuis plus rien.

La mécanique (très publique) du réseau Bitcoins

La volonté du créateur du système est claire : créer un système aussi solide que celui de l’étalon or. L’or est rare (quantité limitée), se conserve indéfiniment et peut être coupé en fractions très petites. Dans le réseau Bitcoins il n’y a que deux constantes :

Le nombre maximal de Bitcoins qui peuvent être créés par le système est de 21 millions (en fait 20.999.999,9769). Nous avons donc déjà produit plus de la moitié des Bitcoins possibles.

La plus petite fraction échangeable correspond à un centième de million de Bitcoin. Elle est appelée un Satoshi.

Comment sont donc créés les Bitcoins et qui en décide ?

La question est importante car elle est la base de la stabilité du système. La réponse est simple : personne… et tout le monde !

Les Bitcoins ne sont pas créés comme des dollars, des Yens ou des Euros, qui sont imprimés par une Banque Centrale, en fonction de décision des gouvernements responsables (ou irresponsables ?). Ils sont créés, comme l’or par des Mineurs (Miners). Regardons de plus près comment cela fonctionne.

Une transaction est créée à chaque fois qu’un vendeur rencontre un acheteur (sur l’Internet) et que les deux parties se mettent d’accord sur le prix. Cet accord se fait par des échanges habilités tels que Mt. Gox (basé au Japon) ou Bitstamp (en Euros), ou encore OTC Exchange (qui permet d’utiliser Paypal). Une liste très complète est disponible. [ https://en.bitcoin.it/wiki/Trade]

Cette transaction est ensuite enregistrée, et c’est à ce niveau que la création de Bitcoins va se faire. Le réseau Bitcoin est un réseau peer-to-peer (comme Skype ou Napster). Les transactions se font entre deux ordinateurs qui ont le même progiciel client (trouvé sur bitcoin.org). Chaque utilisateur a un compte crypté qui va enregistrer ses transactions dans un portefeuille (wallet.dat). Toutes les transactions sont immédiatement et automatiquement publiées sur le réseau Bitcoin. Elles sont lues par les programmes clients d’une catégorie d’utilisateurs spécialisés: les Mineurs.

Les Mineurs parcourent en permanence le réseau et lisent toutes les transactions qui n’ont pas été certifiées dans une période de temps. Pour certifier un Block de transactions, les Mineurs doivent analyser les transactions et calculer un hashcode facilement vérifiable. Les ordinateurs savent faire de tels hashcodes très rapidement. De façon à laisser assez de temps au réseau pour vérifier la légitimité du calcul (et éviter des ventes en double), le système impose une règle simple : il faut que le hashcode commence par un certain nombre de zéros (de l’ordre de quarante zéros). Pour arriver à ce résultat, le Mineur ajoute à la chaine d’information de chaque transaction un nombre arbitraire (le Nonce) et il répète l’opération jusqu’à ce que le nombre commence par le format imposé (The challenge – Le défit). Il n’est pas possible de calculer le Nonce pour obtenir le format espéré. La seule façon et de calculer un hashcode, s’il ne correspond pas au format, changer le Nonce, recalculer, etc. Il faut quelques centaines de millions d’essais pour obtenir une solution, ce qui demande 10 à 20 minutes par Block.

Dès que la combinaison recherchée est trouvée, le Node/Mineur annonce à tous les autres points du réseau qu’il a résolu le problème et publie sa Preuve (Proof of Work). Le Block est alors intégré à la Block Chain qui la liste contenant l’image de toutes les transactions (remontant jusqu’au Bitcoin original).

Pour inciter les Mineurs à faire ce travail de vérification essentiel pour le bon fonctionnement du réseau, ils reçoivent du système un certain nombre de Bitcoins (The Reward). Ce nombre était de 50 BTC à l’origine, depuis May 2013 ce nombre est passé à 25 BTC. En plus du Reward, les mineurs reçoivent aussi les coûts de transaction que chaque vendeur décide de donner pour que sa transaction soit correctement certifiée.

Le système contient des algorithmes pour conserver un certain niveau de difficulté. Tous les 2016 blocks la difficulté de la preuve (en gros le nombre de zéros) est revue en hausse (si le temps passé par l’ensemble des mineurs est trop important, ou en baisse (s’ils ont pu le faire trop vite). La valeur du Reward est aussi automatiquement ajustée : elle est divisée par 2 tous les 210,000 blocks confirmés. Il a été calculé que lorsque le nombre de 21 millions de Bitcoins sera atteint (vers 2140), il sera possible de ne plus payer de Reward, le nombre de transactions sera suffisant pour payer le travail (et l’équipement) des mineurs.

Le système est ainsi merveilleusement stable, précis, publique, et (surtout) totalement décentralisé. Comme l’Internet lui-même, il n’y a pas de centre ou de priorité pré établie, et toute l’information est facilement vérifiable par tous les participants.

Alors, avec une telle mécanique, que peut-on faire ? Bâtir des fortunes, en perdre aussi, tout dépend des participants. Nous verrons dans le prochain article, qu’ils sont hauts en couleurs !

par caroline@inwest.fr | Jan 22, 2026 | Tendances

Gregory Jost affiche le sourire soulagé des âmes arrachées à la morosité européenne. Son arrivée dans la Vallée coïncide avec la fin de l’année 2012: « J’ai toujours aimé voyager. Une expérience ici, après avoir travaillé pour Mozilla Europe en France, cela ne se refusait pas. Je n’ai pas refusé. »

« Greg » fait partie des 71 salariés de la Fondation Mozilla dont la langue maternelle est le français – le nombre total est actuellement de 1033 -. Il est chargé de la promotion de la Fondation depuis les bureaux de Mozilla à San Francisco, situés à quelques encablures de l’Embarcadero et du Bay Bridge. Le reste de l’équipe locale s’est installée à Mountain View, non loin de son concurrent et partenaire Google. San Francisco dispose également d’un espace communautaire, accessible à tous. Il est dédié à la rencontre et au partage – avec les développeurs, contributeurs, traducteurs – via des événement réguliers, accessibles à tous.

Le web est LA plateforme

« Les Etats-Unis – et San Francisco en particulier – sont pour moi le berceau du web. Mon travail y est d’autant plus enrichissant », suggère-t-il. Sa passion pour le web ouvert l’a amené très tôt à collaborer au projet Mozilla. « Mon passé professionnel, ce furent tout d’abord des agences, puis Mozilla. Presque naturellement je dirais, et avant tout pour les valeurs que nous défendons, qui sont les miennes ! » Des valeurs qu’il regroupe autour de trois thèmes: l’universalité du web, le contrôle des données et la confidentialité. Sont-elles toujours au premier plan des avancées technologiques en Silicon Valley ? Pas sûr ! « Nous travaillons ici en Silicon Valley avec… et face aux géants comme Apple, Microsoft et Google. Notre mission est de peser et d’informer pour ne pas enfermer le web dans des plateformes. Le web est la plateforme du futur. C’est aussi pour cela que nous développons Firefox OS sur les marchés émergents… mais également, de plus en plus, dans des grands pays comme l’Allemagne ou l’Italie. Ce n’est que le début. »

La différence entre la France et les Etats-Unis ? « La curiosité, le mouvement et aussi une positivité ambiante. Pour ce qui est de Mozilla, peut-être moins de religion autour du web. Ce n’est pas étonnant si la présence de Mozilla en Europe est historiquement liée à la France. Là-bas, on a une vision plus sociale d’Internet. Ce n’est pas uniquement français, mais très français. Ici, nous sommes au pays du business et des brevets. Le défi est plus difficile à relever, puisque nous rappelons des valeurs fondamentales de partage et d’interopérabilité au moment où le web mobile bascule dans des guerres de… clochers et de brevets. »

Lorsque vous installez Firefox sur un ordinateur, un smartphone ou une tablette, le navigateur vous rappelle vos droits, avant de vous suggérer d’introduire un compte de synchronisation. Cette approche résume assez bien le mandat de la Fondation Mozilla: « être le tiers de confiance du web. » Il répète l’expression plusieurs fois durant l’entretien: « Chez Mozilla, on est là pour créer des produits dont on rêve. Nous n’affichons pas d’objectif de rentabilité. Nous ne sommes pas là non plus pour effrayer les internautes, mais pour leur rappeler qu’ils sont libres. Et qu’ils peuvent avoir confiance en nous, entre notre indépendance. »

Google, le plus gros contributeur financier

En 2012, 90% des revenus de la Fondation Mozilla étaient générés grâce au partenariat noué avec Google. C’est 5% de plus qu’en 2011 et cette année ne devrait pas afficher de surprise en la matière. « Oui, c’est vrai. D’un côté, ce sont nos partenaires. Nous développons pour Android, en plus de Firefox OS, notre propre OS mobile. En même temps, nous restons totalement indépendants dans nos démarches et nos développements. Les relations sont plutôt bonnes dans la Vallée entre nous. Nous travaillons dans cet esprit d’interopérabilité et d’universalité. »

A quoi servent les 311 millions de dollars ? « A poursuivre le développement du navigateur, sur ordinateur, sur mobile. Notre part de marché reste proche des 20 %. Cela nous donne un poids, un contrepoids même. Nous sommes et resterons un contre-pouvoir. Et puis, cet argent, il sert aussi à remplir nos missions de formation, notamment via le site Webmaker. » Le projet Webmaker veut faire des internautes non pas seulement des acteurs, mais également des bâtisseurs de l’Internet… libre.

par caroline@inwest.fr | Jan 22, 2026 | Innovation

Pourquoi tout le monde parle de Big Data ?

L’expression est sur toutes les lèvres et sur tous les écrans. Big Data, c’est le défi informatique de cette décennie, le domaine d’innovation qui émoustille les capitaux risqueurs, et la formule magique qui inspire nos petites décisions au quotidien. Mais c’est quoi exactement, Big Data (ou datamasse en français) ?

Quand on commande un livre ou un grille-pain sur Amazon, l’algorithme du site nous suggère d’autres articles susceptibles de nous plaire étant donnés les achats réalisés par des milliers d’internautes avant nous (c’est ce qu’on appelle targeted merchandizing). Même système pour la plateforme de distribution de contenus culturels Netflix, qui recommande la série Orange is the New Black si l’on a aimé et qu’on attend avec impatience la prochaine saison de Mad Men. Netflix va même plus loin puisque les données récoltées (les passages de films les plus regardés, les moments ennuyeux pendant lesquels les téléspectateurs utilisent la fonction « avance rapide », à quel moment de la journée les contenus sont visionnés, etc.) sont utilisées pour choisir de quels films acheter les droits auprès des studios de cinéma et pour élaborer de nouveaux programmes, comme par exemple la série House of Cards. Google TV et Apple TV pourraient d’ailleurs suivre l’exemple en créant du contenu à partir des données de visionnage récoltées sur leurs plateformes. Les prédictions sont souvent bien affutées.

Pour en savoir plus sur l’algorithme de Netflix, on pourra se rendre ici, et pour un post détaillé sur la façon dont Netflix utilise ses données, là.

Agréger une multitude de cas individuels pour dégager du général

Au degré zéro, « Big Data » fait référence au traitement automatisé de bases de données de très grande ampleur pour repérer des corrélations. L’agrégation d’une multitude de comportements individuels, comme par exemple les achats réalisés sur Amazon, permet la modélisation mathématique d’une tendance – vous avez acheté tel article, vous apprécierez sûrement tel autre.

Pas seulement du commercial

Le type de données analysées ne se réduit pas aux chiffres de vente. Google maps nous propose un trajet optimisé en fonction des conditions de circulation en temps réel, Facebook nous propose de nouveaux amis en fonction des liens déjà établis, les sites de rencontre en ligne nous proposent des partenaires romantiques en fonction de nos réponses à un questionnaire sur nos goûts et nos habitudes. Toutes ces propositions sont formulées grâce à l’analyse d’un grand nombre de données recueillies au préalable. Mêmes avancées dans le domaine de la médecine, avec la possibilité de prédire grâce à l’analyse de milliers d’électrocardiogrammes quels sont les facteurs qui font courir le risque de subir une seconde attaque cardiaque.

Ces exemples nous montrent la puissance des algorithmes et le rôle de plus en plus important que nous les invitons à jouer dans nos vies, du plus trivial au plus important.

Pas seulement du descriptif

Quelle différence alors entre Big Data et les statistiques descriptives traditionnelles ? Les statistiques descriptives nous donnent des renseignements sur l’échantillon sélectionné et visent à rendre compte aussi précisément que possible des caractéristiques de l’échantillon.

Les statistiques inductives (Big Data) analysent un échantillon donné de façon à en déduire les informations sur la population représentée par cet échantillon, pour extrapoler. Les statistiques inductives font donc appel aux probabilités (« proba » pour les intimes) pour établir des relations de causalité, prédire les comportements et monter en généralité.

Le défi technique que représente le traitement de bases de données toujours plus grandes

La gestion informatique de bases de données énormes représente un défi technique important, puisqu’il faut à présent des machines beaucoup plus puissantes pour être capable de stocker et de traiter les données à cette nouvelle échelle de grandeur.

Vous avez probablement entendu les rumeurs qui courent autour de la mystérieuse péniche qui appartiendrait à Google, flottant au milieu de la baie de San Francisco ? Selon certains, il s’agirait d’un gros centre de données refroidi par l’eau fraîche de la baie, comme le laisse suggérer un brevet déposé par Google. Les Big Data sont partout autour de nous, littéralement.

En plus du défi relié à leur stockage, les Big data apportent également un défi technique aux chercheurs. En effet les méthodes d’apprentissage automatique (les algorithmes utilisés pour résumer et prédire au mieux les comportements des individus à partir d’un ensemble de données), doivent être adaptées à ces données, ce qui, de part leur quantité et leur hétérogénéité, augmentent considérablement la durée nécessaire à leur traitement mais aussi potentiellement le taux d’erreur qui doit être contrôlé. Autrement dit, avec Big Data, il y a en même temps la possibilité d’avoir des résultats plus fiables parce que la quantité de données à partir desquelles ils ont été établis est plus grande ; mais on a aussi plus de chance de faire des erreurs car les bases de données sont sont plus grandes et demandent donc un soin particulier dans leur analyse.

Dans un prochain article, nous traiterons de l’élan entrepreneurial autour des Big Data, et de la façon dont le monde politique s’approprie ces nouveaux outils pour mieux comprendre et influencer l’opinion publique.

Nous remercions Anne BITON, chercheure en bio-informatique à l’Université de Berkeley, pour son aide dans la rédaction de cet article.

Ariane Zambiras